Merhabalar, derin öğrenme tabanlı yaklaşımlar hem algoritmaların karmaşıklığı hemde çalışılan verinin büyüklüğünden dolayı çok miktarda donanım kaynağına ihtiyaç duyarlar. Bu kaynaklardan maddeler halinde bahsedecek olursak :

- Verilerin saklanabilmesi için yeterli depolama (HDD-SSD) kapasitesi

- CPU ya da GPU nun veriler üzerinde çalışabilmesi için yeterli hafıza (RAM) kapasitesi

- Online veriler üzerinde çalışılacaksa yeterli bant genişliği

- İşlem gücü için işlemci (CPU) ya da ekran kartı (GPU) kapasitesi

Bilgisayarlarımızda derin öğrenme amaçlı olarak CPU veya GPU yu kullanabiliriz. Yapılan testlerde, derin öğrenme algoritmalarının CPU’ya oranla GPU üzerinde daha hızlı çalıştığı gözlemlenmiştir.

CPU üzerinde derin öğrenme algoritmalarını çalıştırmak için sadece uygulamanızı çalıştırmak yeterli iken GPU için bu durum geçerli değildir. GPU yu kullanabilmek için bazı eklenti ve kütüphanelerin bilgisayarınıza yüklenmesi gerekmektedir.

Bu eklenti ve kütüphanelerin yüklenmesi esnasında sürüm uyumluluğuna dikkat edilmelidir. Dikkat edilmediği taktirde GPU’nuzu kullanmanız mümkün değildir. Aşağıdaki adımlarda birbirleri ile uyumluluğu test edilmiş sürümler kullanılmıştır.

GPU’nun kullanılabilmesi için yapılması gerekenler aşağıda adım adım açıklanmıştır.

1-)Cuda destekli bir GPU’nuz var mı?

TensorFlow ile GPU kullanabilmek için CUDA destekli bir ekran kartına ihtiyacınız bulunmaktadır. Ekran kartınızın CUDA destekli olup olmadığını öğrenmek için tıklayınız.

2-)Nvidia CUDA Toolkit Kurulumu

Ekran kartınız CUDA destekli ise Nvidia CUDA Toolkit 11.2‘yi indirip kurunuz.

3-)cuDNN Kütüphanesinin Kurulumu

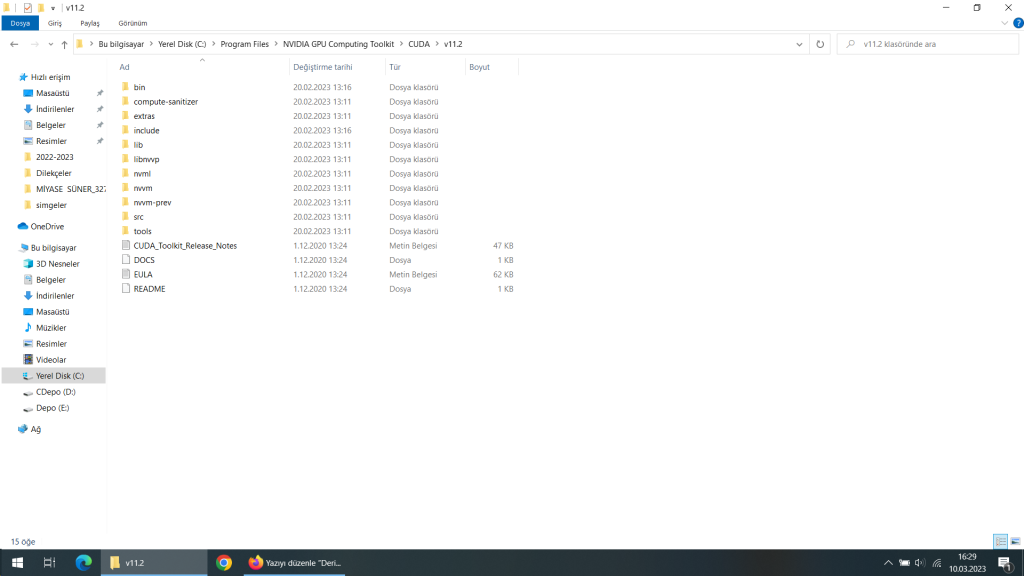

CUDA Toolkit’in kurulumunun ardından Download cuDNN v8.1.0 (January 26th, 2021), for CUDA 11.0,11.1 and 11.2 kütüphanesini indiriniz. Bu kütüphanenin kurulumu için aşağıdaki adımları izleyiniz.

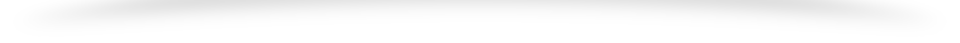

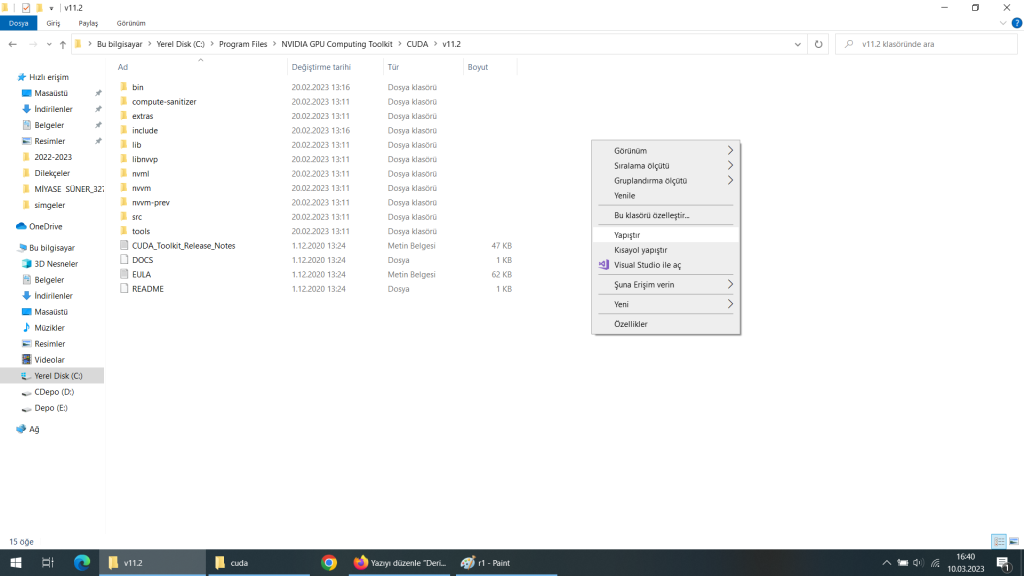

- C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.2 dizinine gidiniz.

- cuDNN kütüphanesini arşivden çıkarınız.

- cuDNN arşivinden çıkarılan bin, include ve lib klasörlerini kopyalayınız ve C:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v11.2 dizinine yapıştırınız.

4-)Anaconda ve Spyder Kurulumu

Anaconda, veri bilimi ile ilgilenenler için pek çok araç içeren bir platformdur. Anaconda kurulumunu indirmek için tıklayınız.

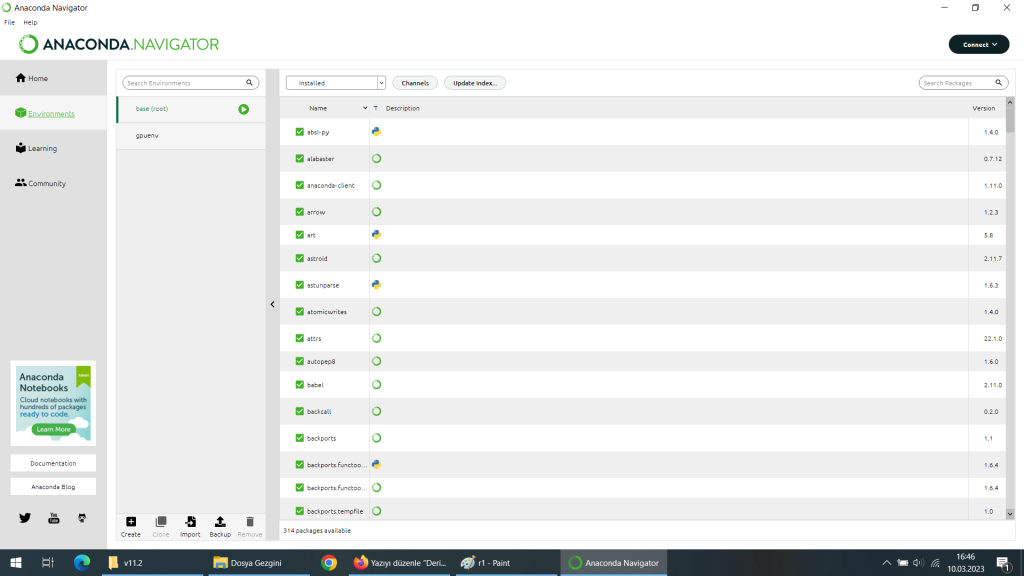

1-)Anaconda kurulumunun ardından Sol taraftaki menüden Environments bölümüne giriş yapıyoruz.

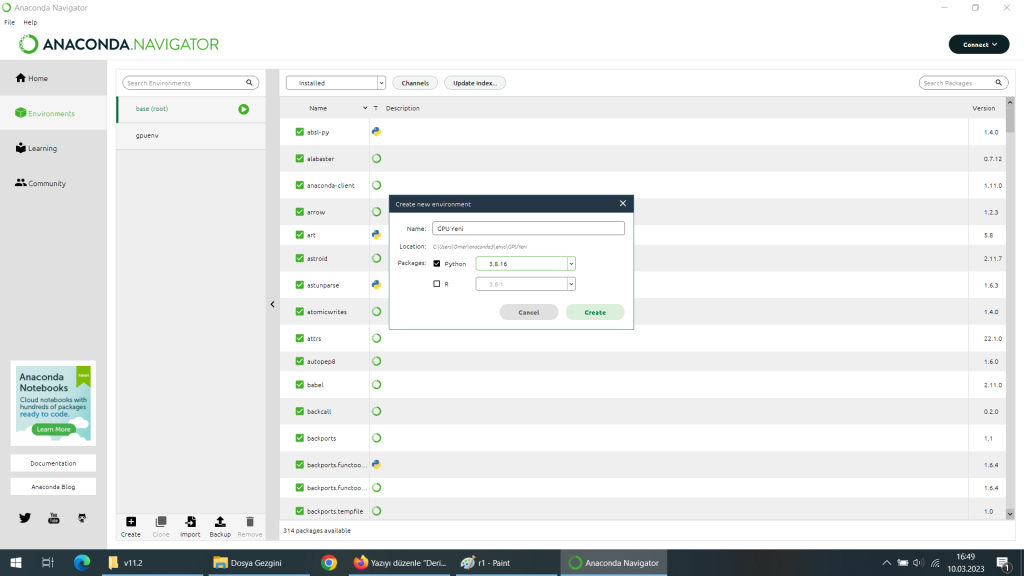

2-)Environments bölümünde, Create diyerek yeni bir Environment oluşturuyoruz. Burada Python versiyonunu 3.8.16 olarak seçiyoruz.

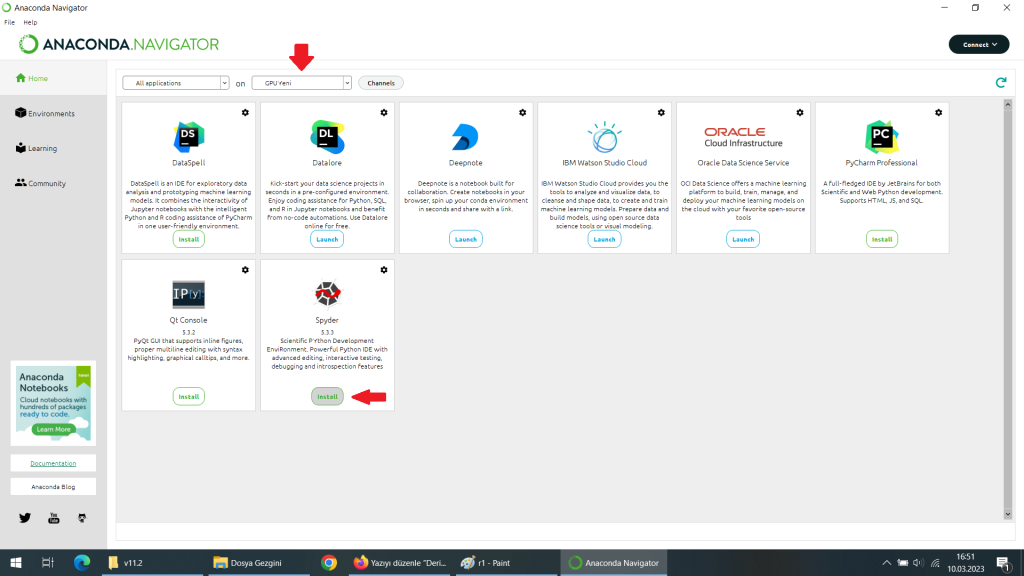

3-)Environment kurulduktan sonra Home bölümüne geçip yeni oluşturduğumuz Environment i seçerek Spyder kod editörünü kuruyoruz.

5-)TensorFlow Kurulumu

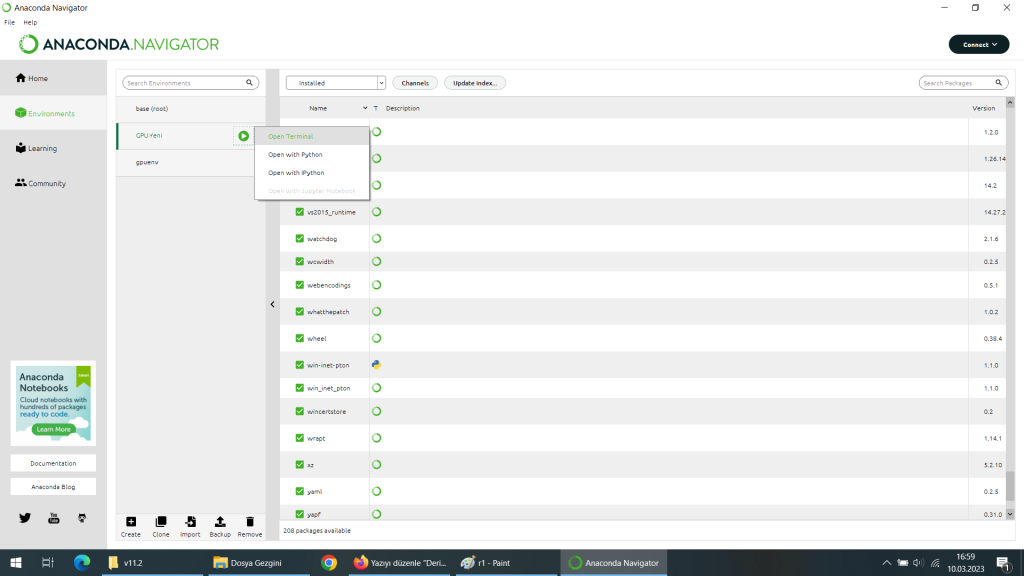

TensorFlow 2.8’in kurulumu için yeni oluşturduğumuz Environment’in terminalini açıyoruz.

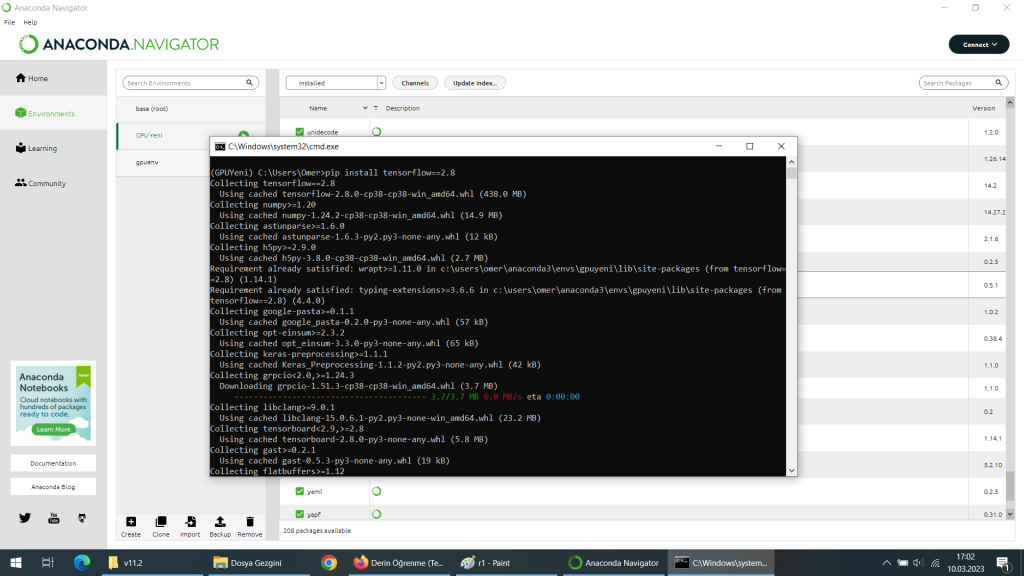

Açılan terminalde aşağıdaki kodu yazarak TensorFlow 2.8’i kuruyoruz.

pip install tensorflow==2.8

6-)Protobuf Versiyon Güncellemesi

Versiyon uyumluluğu için yukarıda açılan terminal (GPUYeni Environment Terminal) vasıtası ile Protobuf versiyonunun güncellenmesi gerekmektedir. Versiyon güncellemesi için aşağıdaki kodu yazıp çalıştırmamız yeterlidir.

conda install protobuf=3.20

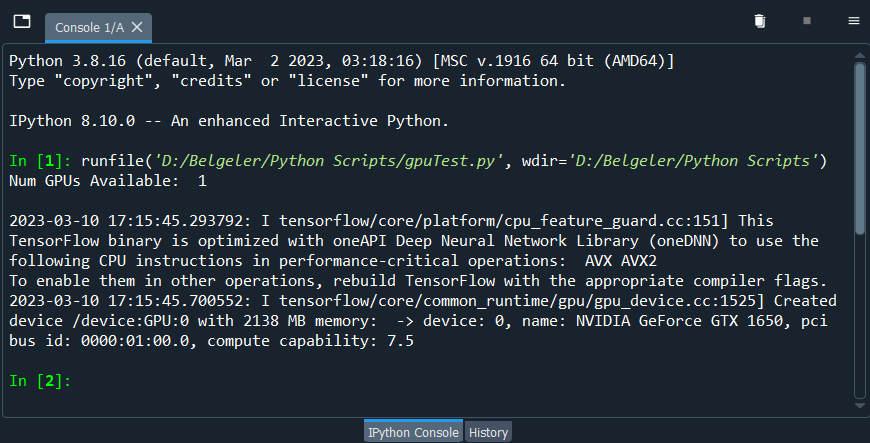

7-)TensorFlow Test

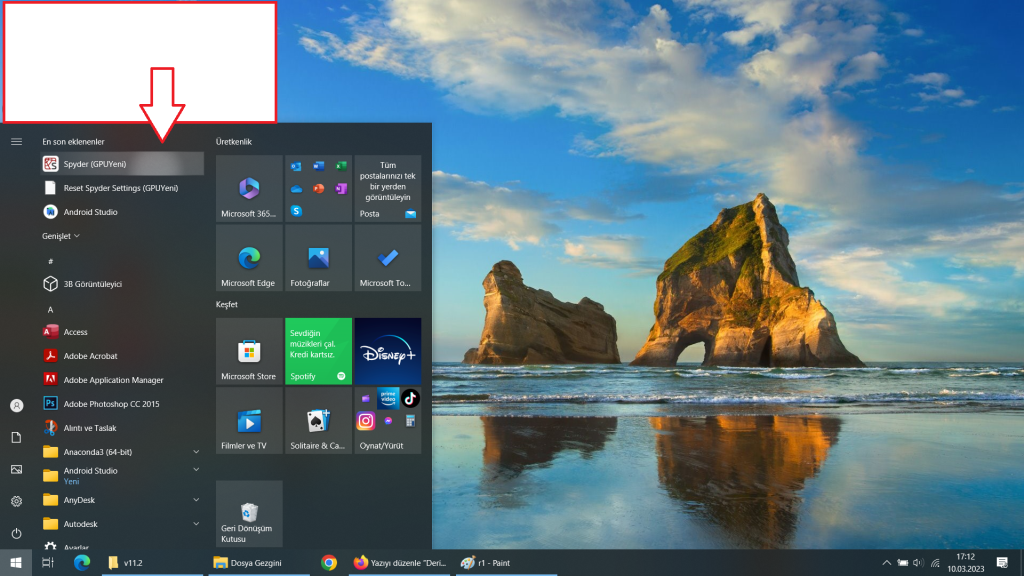

Test aşamasına geçmeden önce Anaconda ve Spyder editörünü (eğer açıksa) kapatınız (Bu uygulamaların kurulum sonrası yeniden başlatılması önemli).

TensorFlow’un GPU ile çalışıp çalışmadığını test edebilmek için öncelikle GPUYeni Environment’i içerisinde kurmuş olduğumuz Spyder editörünü açıyoruz.

Spyder editöründe aşağıdaki kodu yazıp çalıştırıyoruz.

import tensorflow as tf

from tensorflow.python.client import device_lib

print("Num GPUs Available: ", len(tf.config.list_physical_devices('GPU')))

device_lib.list_local_devices()Spyder editörü konsolunda aşağıdaki çıktı görülmelidir. Aşağıdaki çıktıda GPU’nun bulunduğu ve bulunan GPU’nun bilgileri görülmektedir.